Бизнес примеряет deepfake

Как искусственный интеллект используют в компаниях

Бизнес начал использовать deepfake для общения с клиентами. С помощью искусственного интеллекта компании создают виртуальные копии своих сотрудников. Одной из первых применить технологию решила EY (прежнее название — Ernst & Young) — одна из крупнейших в мире консалтинговых и аудиторских компаний. Теперь она общается с клиентами в том числе через deepfake, правда, пока в экспериментальном порядке. Какой смысл и выгоду видит в этом бизнес? И насколько распространенной может стать такая практика? Разбирался Андрей Загорский.

Фото: Denis Balibouse / Reuters

Фото: Denis Balibouse / Reuters

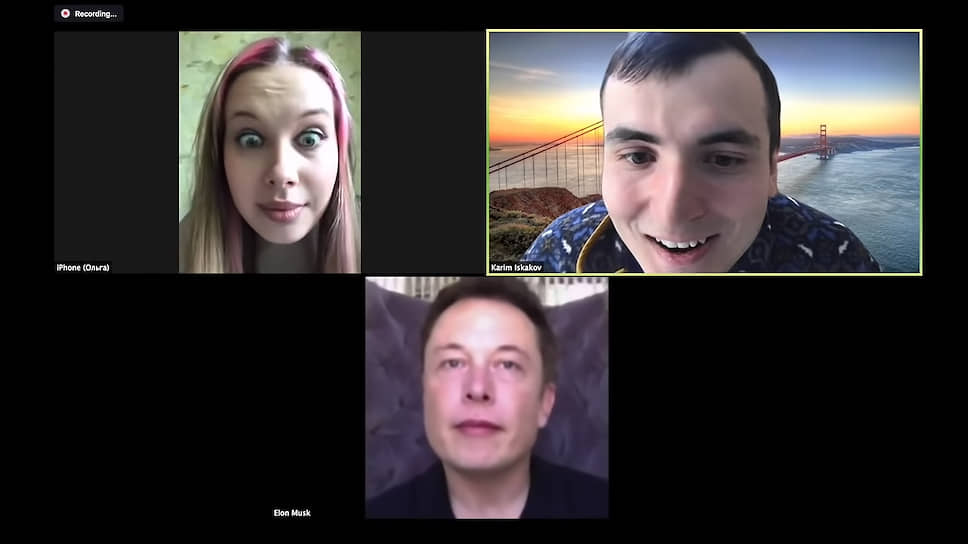

О технологии deepfake многие узнали из социальных сетей. С помощью нехитрых программ пользователи смогли синтезировать изображения известных политиков и бизнесменов и примерять их на себя. Так, во время локдауна в одну Zoom-конференцию ворвался пользователь с лицом Илона Маска. Отличить подделку от реального человека в сети почти невозможно.

Что же касается EY, то она применяет технологию стартапа Synthesia. Эта британская компания способна на основе видео сделать виртуальную копию человека, которую затем можно использовать как угодно — скажем, для озвучивания информационного ролика или текста презентации. Причем все это легко передается вместо обычного текста или привычных графиков по каналам электронной почты. А началось все в марте — именно тогда по просьбе одного из клиентов EY был создан первый виртуальный двойник сотрудника. Случилось так, что «личность дополненной реальности» помогла клиенту выиграть крупную сделку. Узнав об этом, другие партнеры компании тоже захотели использовать виртуальные копии своих работников для продвижения собственной продукции или услуг.

Технология пока лишь тестируется, пояснил “Ъ FM” управляющий партнер EY в СНГ Александр Ивлев: «Вопрос в том, как deepfake будет применяться и в каких областях, в каких зонах взаимодействия с клиентами или с участниками рынка, или с прессой. Можно называть кучу отраслей, где это может использоваться. Пока, на самом деле, этот вопрос остается открытым, потому что сейчас прежде всего нужно проводить различного вида тесты, чтобы понять, где эта технология максимальную пользу принесет. Но каждый год появляется что-то новое, и зачастую это вызывает скептицизм у многих людей. Но подавляющее большинство вещей, которые казались непонятны в самом начале, сейчас активно принимают участие в нашей жизни».

Для изготовления личности дополненной реальности достаточно в течение 40 мин. произносить определенные фразы перед камерой — мимика и голос человека копируются. Звучит вроде бы просто, но, конечно, все это далеко непросто технически. И, разумеется, требуется согласие тех, кого собираются копировать. В EY утверждают, что доступ к технологии строго ограничен, дабы не допустить злоупотреблений.

Каким образом работает технология deepfake

Правда, может возникнуть простой вопрос: зачем все это нужно бизнесу? Руководитель направления исследований Центра финансовых технологий и цифровой экономики «Сколково— РЭШ» Егор Кривошея отмечает, что некоторые варианты применения технологии deepfake очевидны уже сейчас:

«Они могут особо актуальны, например, если на встречах или каких-нибудь презентациях человек не чувствует себя достаточно уверенно, то есть есть какой-то человеческий фактор — технология может помочь выступить хорошо. Либо, например, человеку нужно быть в двух местах одновременно и выступить на двух встречах. В принципе, сейчас увеличивается удаленное взаимодействие по цифровым каналам через те же технологии видеоконференций и всего остального, там deepfake также могут помочь».

Но если технология начнет применяться компаниями массово, насколько вероятно ее использование мошенниками с целью обмана граждан и хищения их средств? Руководитель аналитического центра компании Zecurion Владимир Ульянов полагает, что такая угроза весьма реальна: «Тут есть несколько моментов, касающихся безопасности. Один из векторов угроз — это создание роликов от имени известных людей. Публичные имена и сейчас часто вовлечены в мошеннически схемы. При этом создаются их фейковые страницы в социальных сетях. Если будут создаваться такие персонифицированные видеообращения, им могут поверить реальные люди, поклонники, потому что как будто бы мы верим, что известный человек не будет нас обманывать. И если эту технологию возьмут на вооружение мошенники, то, конечно, они смогут обмануть большое количество людей».

Кстати, похоже, что EY — далеко не единственная компания, экспериментирующая с deepfake или подобными им технологиями. Так, в начале августа компания Nvidia сообщила, что часть сцен на ее апрельской презентации была создана на компьютере, а генерального директора Дженсена Хуанга синтезировали с помощью технологии машинного обучения.