Интеллектуальные правила

Российские компании утвердили первый кодекс этики ИИ

У российского бизнеса появился первый документ, описывающий ключевые принципы этики при разработке и внедрении систем искусственного интеллекта (ИИ). Кодекс носит добровольный характер, присоединиться к нему может не только компания-разработчик, но и любая организация, активно использующая технологию. Документ закрепляет требования об обеспечении безопасности данных, идентификации ИИ и сохранении ответственности за человеком. Предполагается, что наличие общих «нравственных» правил позволит избежать критических ошибок, а также облегчит формирование отраслевого регулирования: в каждом конкретном случае жесткость норм будет соотноситься с рисками системы.

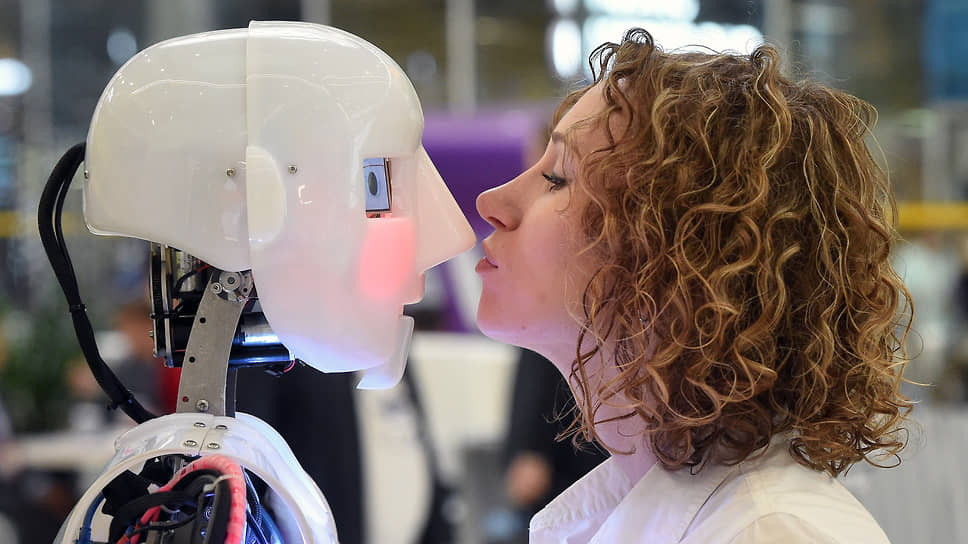

Внедрение кодекса этики ИИ должно повысить доверие пользователей к системам искусственного интеллекта

Фото: Анатолий Жданов, Коммерсантъ

Внедрение кодекса этики ИИ должно повысить доверие пользователей к системам искусственного интеллекта

Фото: Анатолий Жданов, Коммерсантъ

В конце октября целый ряд крупных российских компаний подписал первый для отечественного рынка кодекс этики искусственного интеллекта: он описывает основные нормы этичного поведения бизнеса, ведущего разработку и внедрение технологий в этой области. Кодекс был представлен на площадке международного форума «Этика искусственного интеллекта: начало доверия», позднее на площадке конференции AI Journey к нему присоединились еще восемь компаний.

До появления национального кодекса подобные правила были всего у трех компаний: Сбербанка, «Яндекса» и ABBY, теперь же среди подписантов также «Ростелеком», МТС, Mail.ru, «Газпром нефть», Infowatch, «Росатом», ЦИАН. Помимо этого к кодексу присоединились НИУ ВШЭ, Сколтех, МФТИ, ИТМО, «Иннополис», РФПИ и Институт системного программирования им. В. П. Иванникова РАН. Во вторую очередь подписантов вошли Vision Labs, «Лаборатория "Наносемантика"», АНО «Диалог», Центр речевых технологий, Cognitive Pilot, Центр ИИ МГТУ им. Н. Э. Баумана, а также VEB Ventures, входящая в группу ВЭБ.РФ. При этом на презентации кодекса вице-премьер Дмитрий Чернышенко выразил надежду, что до конца года к нему присоединятся еще до 100 компаний.

Разработкой кодекса занимались Альянс ИИ (включая Сбербанк, который является «ответственной» за развитие технологии корпорацией) и Аналитический центр при правительстве. Пока документ носит добровольный характер, однако его разработка была заложена в стратегию развития ИИ до 2030 года, а также в федеральный проект «Искусственный интеллект». Сейчас кодекс восполняет те пробелы, которые есть в действующем законодательстве. Более того, предполагается, что положения кодекса могут быть расширены и конкретизированы в отраслевых или локальных документах с учетом уровня возможных рисков, а также специфического контекста и среды, в которой применяется технология.

«Высокая масштабируемость ИИ означает, что допускать ошибки крайне рискованно — это может отразиться на огромном числе пользователей, поэтому системы ИИ должны быть безопасны для человека, недопустимо и появление дискриминации — мы видим, что в некоторых странах идет ущемление по половому или расовому признаку. Россия теперь входит в десятку стран, у которых этичность развития ИИ имеет государственное значение»,— пояснил позицию правительства Дмитрий Чернышенко.

Всего подобные документы действуют в 20 странах, у 35 крупных компаний в мире уже есть собственные кодексы, но нормативное регулирование в этой области по-прежнему остается одной из наиболее обсуждаемых тем — в Китае, США и ЕС реализуются различные подходы как к определению этических принципов, так и к жесткости внедрения тех или иных норм. В Китае ИИ активно используется для распознавания лиц и в инструментах скоринга, в Европе же, напротив, вводятся очень жесткие ограничения на использование личных данных.

Новые принципы

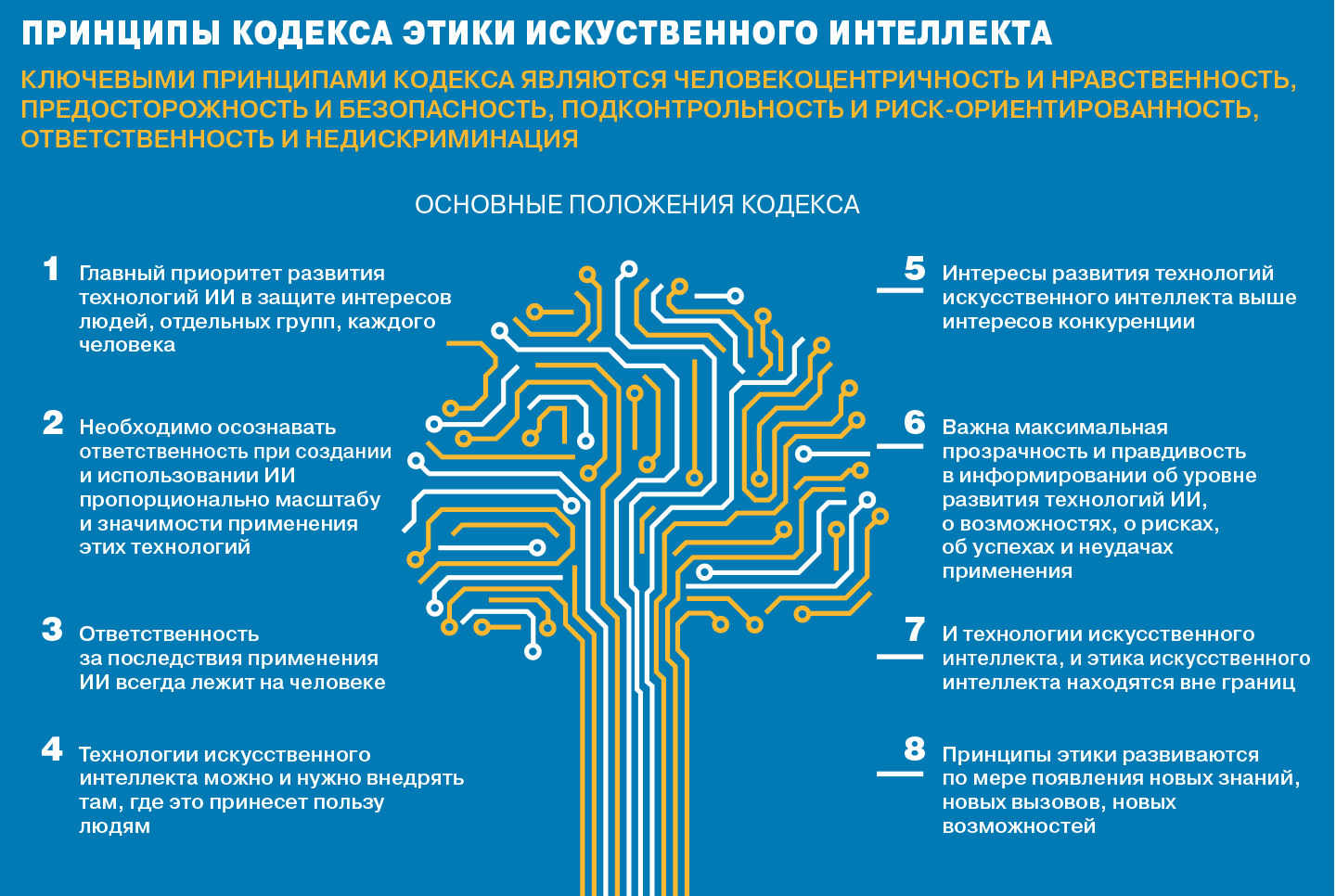

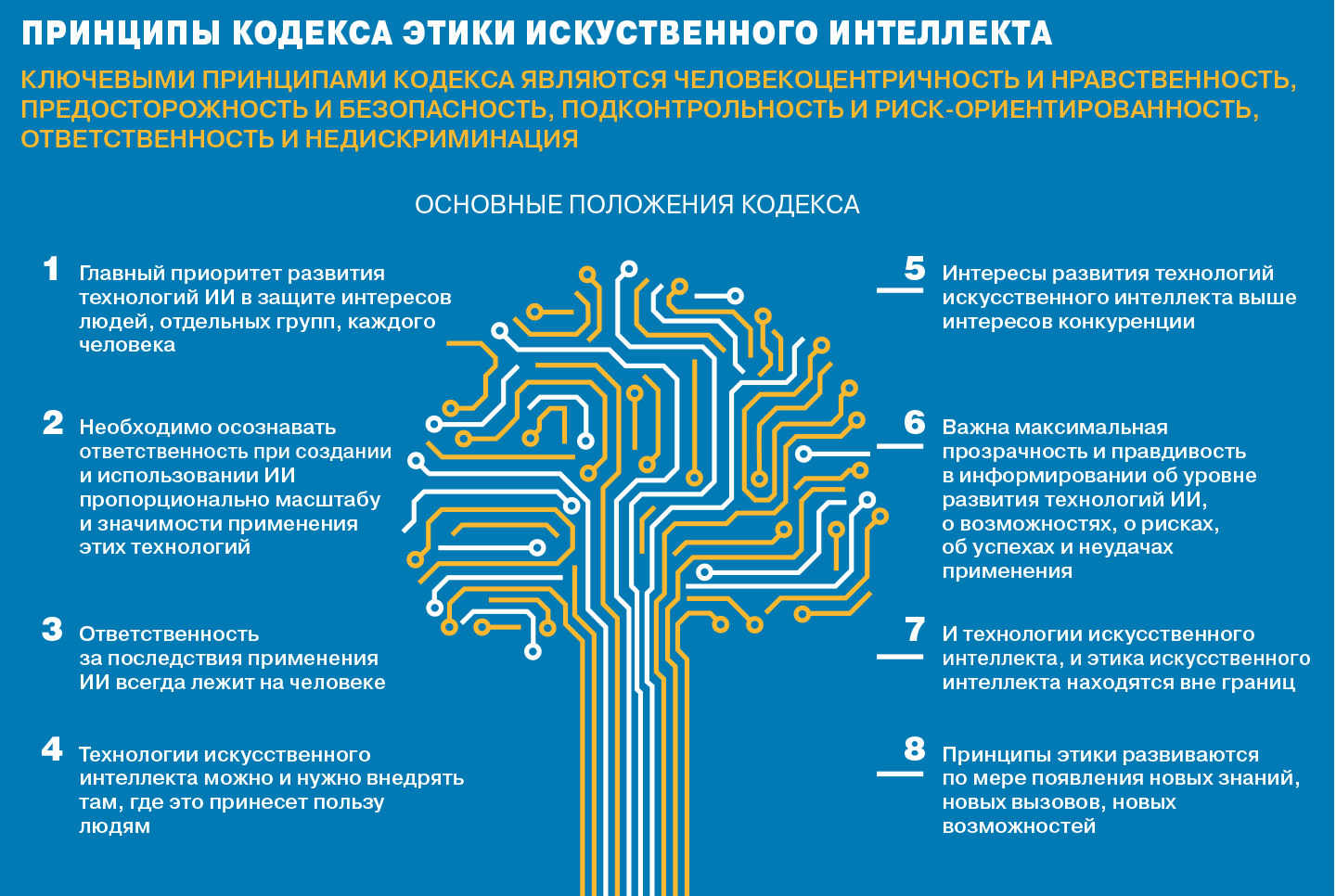

Положения кодекса расписаны на 12 страницах и разделены на два блока: первый описывает основные принципы этики и правила поведения, а второй посвящен применению кодекса — правовой основе, механизмам присоединения и реализации документа.

Первый принцип закрепляет защиту интересов и прав людей и отдельного человека в качестве приоритета в развитии ИИ — в частности, компании должны придерживаться человекоориентированного и гуманистического подхода (этот критерий должен стать центральным при оценке этичного поведения разработчиков и компаний, внедряющих ИИ). Бизнес должен учитывать ключевые ценности, такие как сохранение и развитие когнитивных способностей человека, уважать автономию и свободу воли человека — это касается в первую очередь сохранения права выбора и отсутствия негативного влияния на него, соответствовать закону, не прибегать к дискриминации, а также проводить оценку рисков и гуманитарного воздействия (в том числе в особо важных случаях — с привлечением нейтральной третьей стороны или уполномоченного официального органа).

Второй принцип требует осознавать ответственность при создании и использовании ИИ и придерживаться риск-ориентированного подхода, то есть соотнесения жесткости регулирования с потенциальным влиянием системы (методику оценки рисков предлагается разработать дополнительно). Также принцип предусматривает идентификацию ИИ при общении с человеком — это особенно актуально при распространении чат-ботов и голосовых помощников. В кодексе указано, что идентификация необходима, «когда это затрагивает вопросы прав человека и критических сфер его жизни».

Еще один аспект — это безопасность работы с данными и информационная безопасность. Подписанты должны обеспечивать охрану и защиту персональных данных, обработка которых осуществляется системами ИИ, разрабатывать и внедрять «инновационные методы борьбы с несанкционированным доступом третьих лиц к персональным данным», а также использовать «качественные и репрезентативные наборы данных», полученные без нарушения закона из надежных источников — именно от данных зависит то, чему «научится» система ИИ и как именно сработают алгоритмы. Для проверки «качества» системы предусмотрена также добровольная сертификация на соответствие положениям кодекса.

Третий принцип фиксирует распределение ответственности — она всегда должна оставаться за человеком (в том числе на ИИ не должны перекладываться «полномочия ответственного нравственного выбора»). Также компаниям рекомендуется сотрудничать в выявлении и проверке информации о способах и формах создания систем «сильного ИИ» и предотвращении возможных угроз, которые они несут. При этом в документе закреплено, что применение технологий «сильного» ИИ должно находиться под контролем государства.

Четвертый принцип фиксирует, что технологии ИИ нужно применять по назначению и внедрять там, где это принесет пользу людям (отдельно указывается, что внедрение ИИ должно происходить с учетом национальных приоритетов), а пятый ставит интересы развития технологий ИИ выше интересов конкуренции — это касается в первую очередь сотрудничества разработчиков, в том числе для обмена информацией о выявленных критических уязвимостях, чтобы предотвратить их массовое распространение. Также компаниям рекомендуется повышать доступность данных (в том числе размеченных) и обеспечивать совместимость систем там, где это необходимо.

Наконец, шестой принцип указывает на важность максимальной прозрачности и правдивости в информировании об уровне развития технологий ИИ, их возможностях и рисках. Раскрытие информации позволит защитить пользователей и повысить уровень доверия к системам ИИ, что является ключевым условием более активного внедрения технологии.

«Мы — хорошие»

Присоединяясь к кодексу, компании добровольно соглашаются следовать его рекомендациям. При этом в будущем соблюдение этических принципов может стать одним из критериев при предоставлении мер поддержки.

Для того чтобы следить за реализацией кодекса, компании-подписанты должны в течение двух месяцев назначить уполномоченных по этике ИИ или создать коллегиальные отраслевые органы — внутренние комиссии по этике в сфере ИИ для рассмотрения наиболее актуальных или спорных вопросов. В свою очередь, для контроля за исполнением кодекса планируется создание специальной комиссии по этике на базе ассоциации Альянса ИИ.

В кодексе отмечается, что комиссия может иметь рабочие органы и группы, состоящие из представителей бизнес-сообщества, науки, государственных органов и иных заинтересованных сторон. Именно комиссия будет рассматривать заявления компаний на присоединение к положениям кодекса и вести «реестр акторов ИИ», который будет публичным. Также ожидается появление свода наилучших и наихудших практик решения возникающих этических вопросов в жизненном цикле ИИ.

Крупные компании уже понимают важность этического регулирования: по словам первого заместителя председателя правления Сбербанка Александра Ведяхина, этический комитет по ИИ в банке — один из самых сложных, более того, именно этическая часть внедрения технологии привела к проблемам в больших корпорациях, столкнувшихся с падением стоимости акций и уходом клиентов. Председатель правления МТС Вячеслав Николаев отметил на форуме, что бизнесу важно самостоятельно ограничивать себя, не дожидаясь обязывающего регулирования, а директор по развитию технологий искусственного интеллекта «Яндекса» Александр Крайнов добавил, что кодекс, с одной стороны, дает возможность разработчикам не наступать на те же грабли и действовать аккуратно, а с другой — позволяет компаниям публично заявить обществу, что «мы — хорошие».